DeepLearning向け

仕様から絞り込んで検索する

製品一覧

対象の製品はありませんでした。

-

- HPC5000-XERGPU10R5S<新製品>詳細を見る

-

NVIDIA® GPUを最大10基搭載可能な2CPU構成の

Deep Learning(深層学習)向けハイエンドGPUサーバーGPU10基搭載可能最大4TBメモリ5UラックマウントIPMI2.0標準搭載

-

- HPC5000-XSRGPU10R5S<新製品>詳細を見る

-

NVIDIA® GPUを最大10基搭載可能な2CPU構成の

Deep Learning(深層学習)向けハイエンドGPUサーバーGPU10基搭載可能最大4TBメモリ5UラックマウントIPMI2.0標準搭載

-

- HPC5000-XERGPU4R2S<新製品>詳細を見る

-

NVIDIA® GPUを最大4基搭載可能

2UサイズのハイエンドGPUラックマウントサーバーGPU4基搭載可能最大128コア(2CPU)最大4TBメモリ2UラックマウントIPMI2.0標準搭載

-

- HPC5000-XSRGPU4R2S<新製品>詳細を見る

-

NVIDIA® GPUを最大4基搭載可能

2UサイズのハイエンドGPUラックマウントサーバーGPU4基搭載可能最大120コア(2CPU)最大4TBメモリ2UラックマウントIPMI2.0標準搭載

-

- HPC5000-XERGPU4R4S-NVL詳細を見る

-

NVIDIA® H100 SXM5を4基搭載可能な2CPU構成の

Deep Learning向けウルトラハイエンドGPUサーバーGPU4基搭載可能最大2TBメモリ4UラックマウントIPMI2.0標準搭載

-

- HPC5000-XERGPU10R4S詳細を見る

-

NVIDIA® GPUを最大10基搭載可能な2CPU構成の

Deep Learning向けハイエンドGPUサーバー

GPU10基搭載可能最大4TBメモリ4UラックマウントIPMI2.0標準搭載

-

- HPC5000-XERGPU4TS詳細を見る

-

NVIDIA® GPUを2CPUで4基搭載可能

Deep Learning向けハイエンドGPUワークステーション

GPU4基搭載可能最大72コア(2CPU)最大2TBメモリタワーTypeIPMI2.0標準搭載

-

- HPC5000-EGNGPU10R4S詳細を見る

-

AMD EPYC™ (Genoa)を2CPU搭載し、

NVIDIA® GPUを最大10基搭載可能

Deep Learning向けハイエンドGPUサーバー

GPU10基搭載可能最大256コア(2CPU)最大3TBメモリ搭載可能IPMI2.0標準搭載HDD/SSD24台搭載可4Uラックマウント

-

- HPC5000-XSRGPU4TS-LC詳細を見る

-

最大4基の水冷式NVIDIA® A100と

2基のCPUを搭載可能な静音性に優れた

水冷式ハイエンドGPUワークステーション水冷GPU4基搭載可能最大64コア(2CPU)最大1TBメモリタワーTypeIPMI2.0標準搭載

-

- HPC5000-EGNGPU8R4S詳細を見る

-

AMD EPYC™ (Genoa)を2CPU搭載し、

NVIDIA® GPUを最大8基搭載可能

Deep Learning向けハイエンドGPUサーバーGPU8基搭載可能最大256コア(2CPU)最大3TBIPMI2.0標準搭載HDD/SSD24台搭載可4Uラックマウント

-

- HPC3000-XSR116TS詳細を見る

-

インテル® Xeon® W-3400/3500プロセッサー搭載

HPCワークステーション最大60コア(1CPU)最大2TBメモリタワーTypeIPMI2.0標準搭載

-

- HPC3000-TRPR108TS詳細を見る

-

AMD Ryzen Thread Ripper Proプロセッサー搭載、

NVIDIA GPU最大4基搭載可能なDeep Learning向け

ハイエンドGPUワークステーション

AMD RyzenGPU搭載可能最大1TBメモリタワーTypeIPMI2.0標準搭載

-

- HPC5000-XILGPU4TS詳細を見る

-

ラックマウントにも対応する

ハイエンドGPUワークステーションGPU4基搭載可能最大80コア(2CPU)最大2TBメモリタワーTypeIPMI2.0標準搭載

-

- HPC5000-XSRGPU4TS詳細を見る

-

NVIDIA® GPUを2CPUで4基搭載可能

Deep Learning向けハイエンドGPUワークステーション

GPU4基搭載可能最大120コア(2CPU)最大2TBメモリタワーTypeIPMI2.0標準搭載

-

- HPC3000-EGNGPU10R4S詳細を見る

-

AMD EPYC™ (Genoa)を1CPU搭載し、

NVIDIA® GPUを最大10基搭載可能

Deep Learning向けハイエンドGPUサーバー

GPU10基搭載可能最大128コア(1CPU)最大3TBIPMI2.0標準搭載HDD/SSD8台搭載可4Uラックマウント

-

- HPC5000-XSRGPU10R4S詳細を見る

-

NVIDIA® GPUを最大10基搭載可能な2CPU構成の

Deep Learning向けハイエンドGPUサーバー

GPU10基搭載可能最大4TBメモリ4UラックマウントIPMI2.0標準搭載

-

- HPC5000-XSRGPU8R8S-NVL詳細を見る

-

NVIDIA® H100 SXM5を8基搭載可能な2CPU構成の

Deep Learning向けハイエンドGPUサーバーGPU8基搭載可能最大4TBメモリ4UラックマウントIPMI2.0標準搭載

-

- HPC5000-EGNGPU8R8S-NVL詳細を見る

-

NVIDIA® H100 SXM5を8基搭載可能な2CPU構成の

Deep Learning向けハイエンドGPUサーバーGPU8基搭載可能最大192コア(2CPU)最大3TBIPMI2.0標準搭載HDD/SSD24台搭載可4Uラックマウント

-

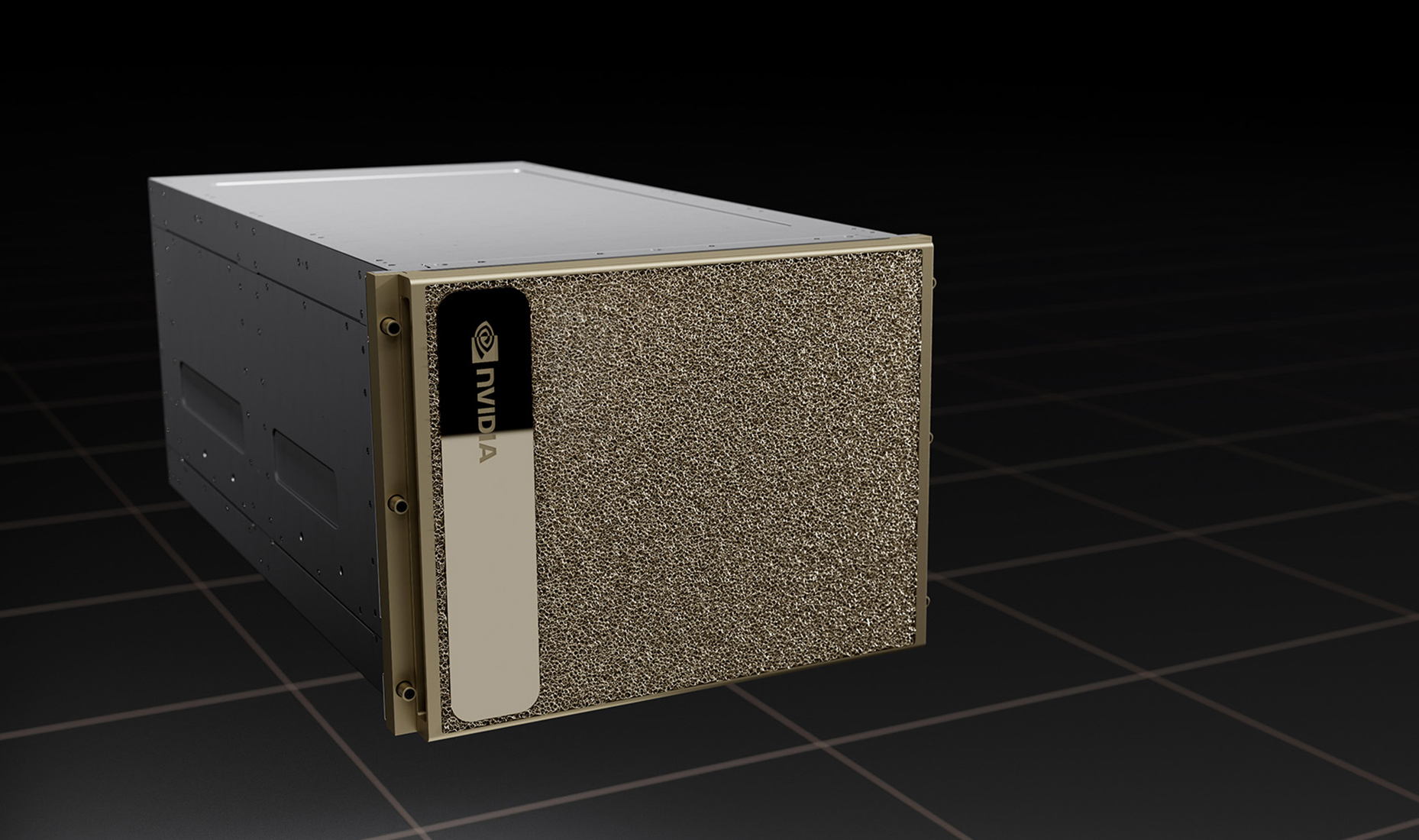

- NVIDIA DGX H100詳細を見る

-

NVIDIA H100上に構築された

世界初のAIシステム8基のNVIDIA H100 TensorコアGPUに

より32 PFLOPS のAI演算性能すべてのAIワークロードに対応する

ユニバーサルシステム7.2 テラバイト/秒の GPU 間双方向帯域幅H100 TensorCore

データ分析、高性能コンピューティングで

これまでにない加速

-

- HPC5000-XILGPU6R2S詳細を見る

-

NVIDIA® GPUを最大6基搭載可能

2UサイズのハイエンドGPUラックマウントサーバーGPU6基搭載可能最大2TBメモリ2UラックマウントIPMI2.0標準搭載

-

- HPC3000-XILGPU4TS詳細を見る

-

ラックマウントにも対応する

ハイエンドGPUワークステーションGPU4基搭載可能最大40コア(1CPU)最大2TBメモリタワーTypeIPMI2.0標準搭載

-

- HPC5000-XILGPU10R4S詳細を見る

-

4UサイズのスーパーハイエンドGPUラックマウントサーバー

GPU10基搭載可能最大4TBメモリ4UラックマウントIPMI2.0標準搭載

-

- HPC5000-EMLGPU8R4S詳細を見る

-

4UサイズでNVIDIA GPU 8基搭載

スーパーハイエンド

GPUラックマウントサーバーAMD EPYC™2CPUメモリ最大4TBGPU8基搭載可能4UラックマウントIPMI2.0標準搭載

-

- HPC3000-EMLGPU4TS詳細を見る

-

ラックマウントにも対応する

Deep Learning 向けGPUワークステーションGPU4基搭載可能最大64コア(1CPU)最大1TBメモリPCI-Express 4.0対応IPMI2.0標準搭載

-

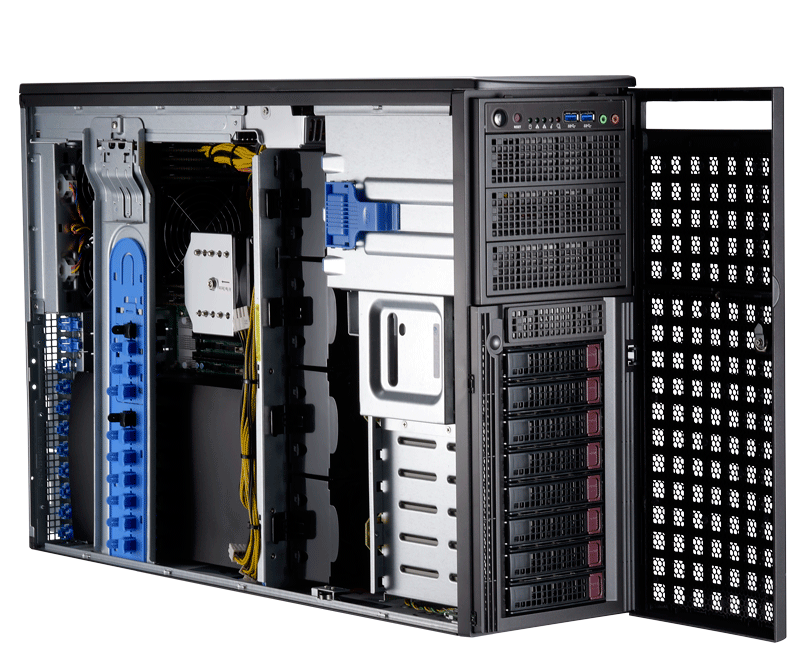

- NVIDIA DGX A100詳細を見る

-

NVIDIA A100上に構築された

世界初のAIシステム8基のNVIDIA A100 TensorコアGPUにより5 PFLOPS のAI演算性能すべてのAIワークロードに対応するユニバーサルシステムGPU用メモリは帯域幅12.4TB/秒A100 TensorCore

データ分析、高性能コンピューティングで

これまでにない加速

-

- HPC3000-XCLGPU4R1T詳細を見る

-

省スペース高密度実装GPUサーバー

GPU4基搭載可能最大28コア(1CPU)最大768GBメモリ1UラックマウントIPMI2.0標準搭載

お問い合わせ

平日9:30~17:30 (土曜日、日曜日、祝祭日、年末年始、夏期休暇は、休日とさせていただきます。)